使用IPA获取你的照片的面部特征。

使用插件:https://github.com/cubiq/ComfyUI_IPAdapter_plus

这里使用的是4合1的输入Node,你可以输入4张图片,并调节每张图的权重。

如果你只有一张图片也是可以的,给每个图像加载器里重复放置即可。

图片质量影响最后出图质量和相似度,请使用方形面部特写照片,越清晰越好。

模型安装问题:

分为IPA模型和Clip视觉模型两部分。

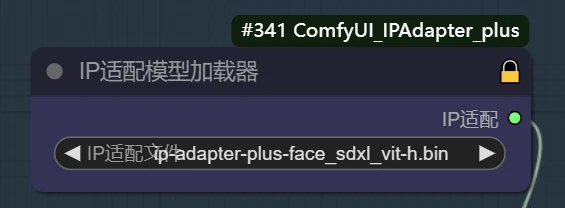

IPA模型:

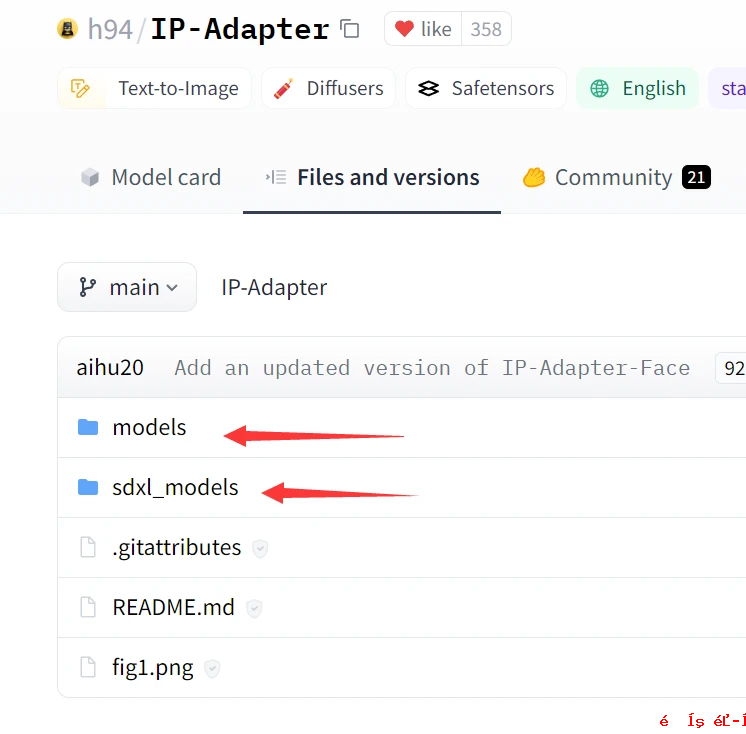

模型下载地址:https://huggingface.co/h94/IP-Adapter/tree/main

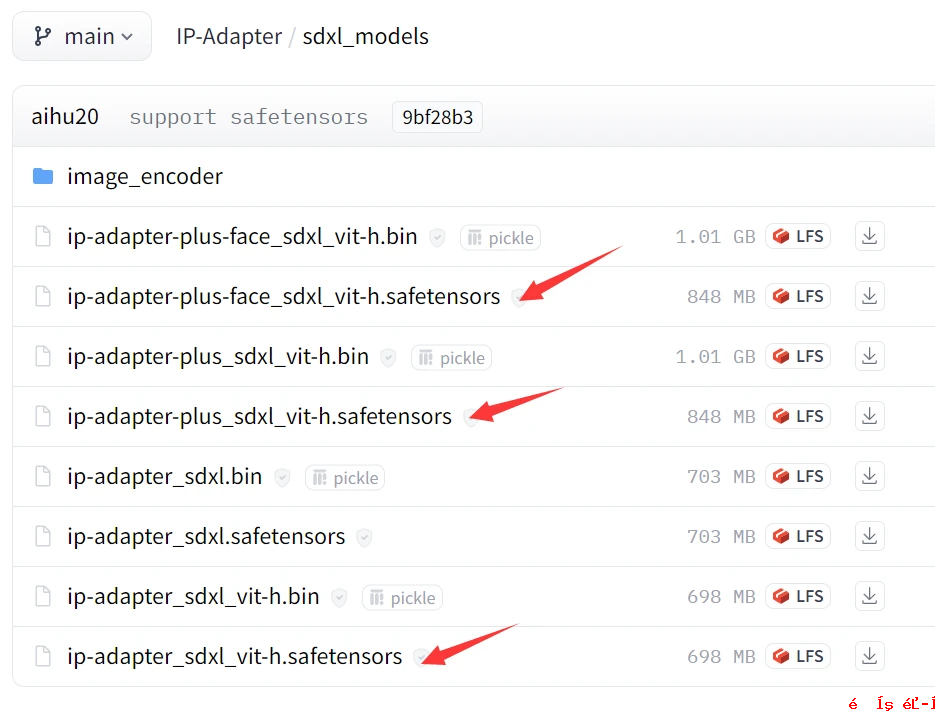

Model文件夹下是1.5版本。SDXL_Model文件夹下是XL版本。

Bin格式和Safetensors格式选一种就行。

下载下来的模型放到插件下的Model目录内:ComfyUI_windows_portable\ComfyUI\custom_nodes\ComfyUI_IPAdapter_plus\models

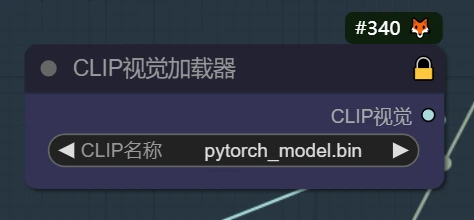

Clip视觉模型:

1.5对应版本:https://huggingface.co/h94/IP-Adapter/resolve/main/models/image_encoder/model.safetensors

XL对应版本:https://huggingface.co/h94/IP-Adapter/resolve/main/sdxl_models/image_encoder/model.safetensors

下载下来的模型文件放到系统内的clip_vision目录下:ComfyUI_windows_portable\ComfyUI\models\clip_vision

说明:

IPA模型分1.5版和XL版。

XL在后期推出了Vit-h版本,效果更好,推荐使用后缀带Vit-h的版本。

需要注意的是Vit-h版虽然是XL版本的模型,但是对应的Clip视觉模型却是要选择1.5的版本。

IPA模型在功能上,又分为base版,Plus版和Face版。

可以理解为,Base版学习原图的强度适中,Plus版会学的更像,Face版专注于面部特征的学习。请根据情况酌情使用。

在CuteYou工作流中请使用:ip-adapter-plus-face_sdxl_vit-h.safetensors

1、IP-Adapter模型

IP-Adapter是腾讯团队开发的适配器模型,能和ControlNet很好的组合使用,控制人物的姿态。

共有两个,分别是SD1.5和SDXL使用

拷贝至ComfyUI\models\instantid

ip-adapter.bin

ip-adapter_sdxl.bin

需要注意的是,有些SDXL大模型因为训练集的原因,也需要使用ip-adapter.bin,遇到报错提示时可以更换一下IP-Adapter模型。

2、ControlNet模型

拷贝至ComfyUI\models\controlnet

control_instant_id_sdxl.safetensors

3、人脸识别和分析模型

antelopev2模型,安装路径:ComfyUI\custom_nodes\ComfyUI_InstantID\models\antelopev2

这组模型和其他换脸插件的insightface模型是通用的,但多两个,insightface模型安装路径:ComfyUI\models\insightface

安装完这些模型,最基本的功能就可以跑起来了,如果你的显卡小于16G,就不用再装其他模型了,因为跑不动!

版权声明:本文为原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

关注微信公众号:"cq_xifan";